AI換臉 惡名遠播 偵破技術 辨真偽 |STEM教室

2025-01-01 14:00

民間常言「有片有真相」,但原來今日的人工智能技術,可肆意操縱你的臉,說出你沒說過的話、做出你沒做過的事,甚至在韓劇《黑色太陽》裏,就有兇手在監控鏡頭,借主角的臉犯罪的橋段。

Deepfake(深偽技術),以人工智能偽造臉部圖像,合成影片。近年,還因不斷傳出犯罪事件而「惡名遠播」,各地政府對此憂心忡忡,研究立例監管之外,更促請專家研發辨偽技術,對抗氾濫的「Deepfake」。一場真與假的攻防戰,掀起帷幕。

「合成相」概念的換臉技術

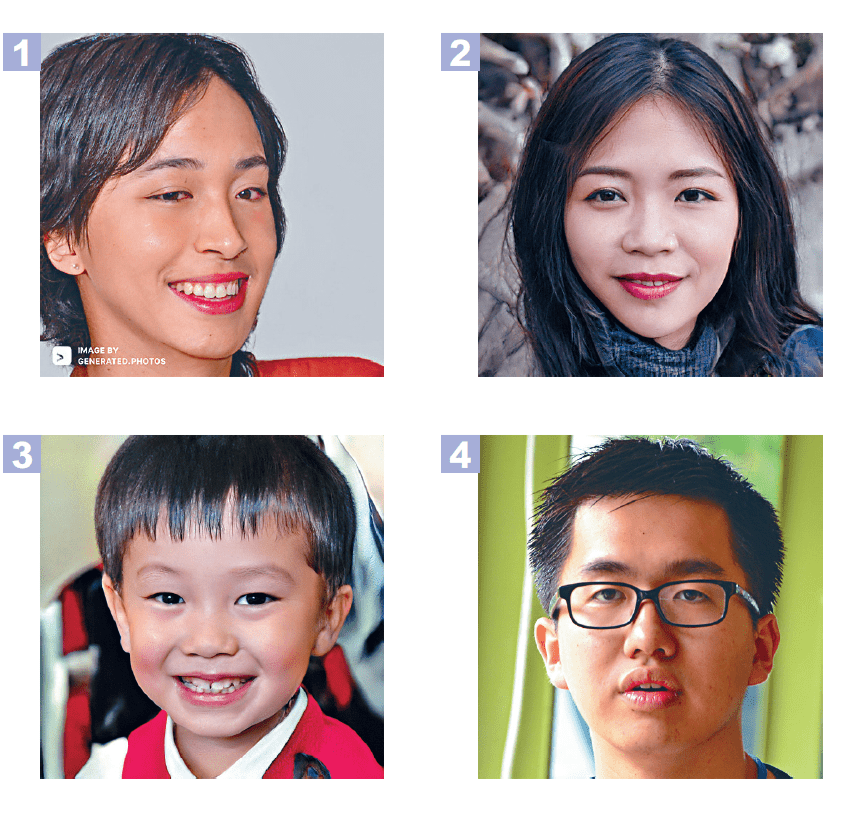

探討「真與假」之前,先和各位同學玩玩遊戲。以下只有一張是真實存在的臉孔,其餘都是用AI技術合成的「假面」。大家能夠一眼看出端偽,找出真正的人臉嗎?

如果大家對 Deepfake 一頭霧水,只要知道它與「合成相」的概念相似,再進一步加上深度學習(Deep Learning)與人工智能技術(Artificial intelligence,AI),利用既有的圖像進行加工、重疊,便可合成新照片甚至影片。

人類表情千變萬化,小小臉皮下藏着43條肌肉,有十分豐富的圖像訊息,一向難以合成造假。2014年,Google Brain 的研究員 Ian Goodfellow 首次提出了 Deepfake 深度學習的原創概念,加上 AI 深度學習技術「生成式對抗網絡」(Generative Adversarial Networks,GAN)出現,電腦能高速而精確地運算,把人臉分析、拆解再重構,組合成想要的面貌和表情,逐漸達到以假亂真的效果,便是大家現時見到的「換臉技術」。

進入「造假」大時代

2017年,外國網上討論區 reddit 有不良分子藉此技術製作色情短片,不少人爭相模仿,更濫用於假新聞、抹黑名人等等惡意用途,自此人們稱其為「Deepfake」。由於 Deepfake 技術容易取用,網上流傳不少開源程式,使用者甚至毋須理解任何原理,安坐家中便可以自動生成「假片」,使得亂象叢生。

2019年,網上已有逾1萬部公開的 Deepfake 影片,至2020年,數字達到5萬部,增長速度以倍數上升,當中更陸續傳出有關 Deepfake 的犯罪活動,情況堪憂。

換臉:從圖片到影片

Deepfake 到底如何把你的表情和說話套上另一個人的臉呢?原來,演算法會先經過「訓練」,當你把A和B兩人的照片交付 Deepfake 編碼器,演算法通過大量真實照片,拆解並分析他們的五官特徵,儲存於極少的潛在空間(latent space),演算法的解碼器用這些碎片還原成完整的人臉;接着,編碼器便可以A的表情、嘴形等特徵,套用於B的臉孔上,生成一段以假亂真的換臉影片。

臨摹畫家與鑑畫師

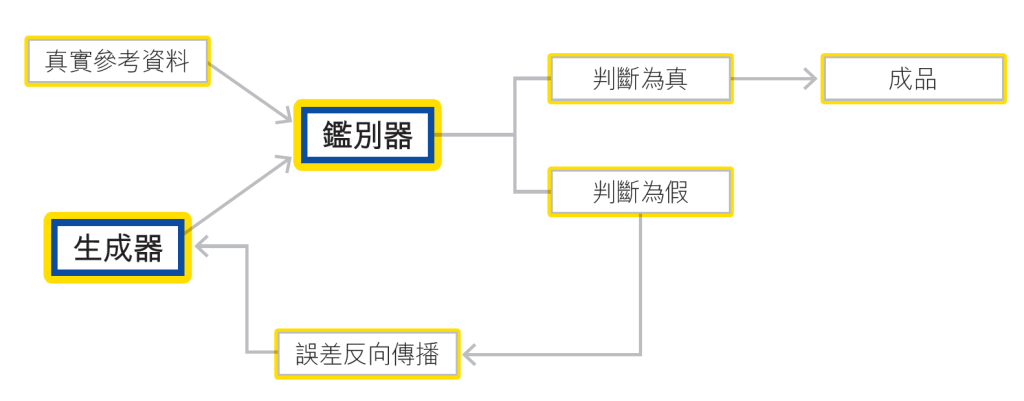

Deepfake 的核心技術是「生成式對抗網絡」,概念就如一個臨摹畫家與鑑畫師的矛盾大對決,前者盡力繪製仿品,後者則負責拆穿謊言,至死方休。

演算法內部會分成兩個對立的部門,「生成」( Generator) 與「鑑別」(Discriminator),當鑑別器認出仿品,便會作出誤差反向傳播(backpropagation),生成器因應反向的結果,作出更新和改良,然後再次挑戰,直到成功騙過鑑別器的法眼。過程中,不需人手操作,全是演算法的內部鬥爭,屬於非監督式學習(Unsupervised learning)的一種。

應用程式犯案

其實,即使 Deepfake 背後涉及複雜人工智能的科學原理,但坊間流傳各種開源「換臉程式」,用家毋須理解 AI 如何運作亦可隨意應用。因此,技術面世至今短短數年,世界各地也傳出不少有關的罪案,使 Deepfake 臭名遠播:

【台灣】

2022年10月,台灣網絡紅人「小玉」利用 Deepfake 換臉技術製作色情影片,獲利超過一千萬台幣。當地政府以「散播猥褻物」與「妨害名譽」等罪拘捕涉案者,事件引起社會關注「數碼化的性暴力」罪案。

【英國】

2019年3月,據《華爾街日報》報道,英國一家能源公司被騙取超過 24 萬美金。騙徒利用 Deepfake 技術製作錄音,假冒公司高層向員工指示提款,由於錄音仿真度極高,不論是聲綫,還是語氣都毫無破綻,員工不虞有詐,依言行事。直至貪心的騙徒三度要求提款,惹起疑心,才最終落網。事件反映 Deepfake 與商業詐騙或會成為新的犯罪組合。

英國駐港公司女職員墮Deepfake騙局 遭AI「上司」視像會議呃400萬元

深偽技術呃跨國企業2億元案 工程公司奧雅納證遇騙 有份建設港珠澳大橋

補充資料

創傷數位化(The Digitisation of Trauma)

數碼科技的進步,為我們帶來便利的同時,亦衍生出相關的罪案。除了常見的金錢損失之外,網絡罪案亦經常對受害人心理帶來嚴重創傷,這種數位時代特有的情況稱為「創傷數位化」(The Digitisation of Trauma)。常見有網絡欺凌、惡意中傷、散播謠言等,皆借助網絡傳播的威力傷害他人。而 Deepfake 最為人詬病之處,便是 「偷取」受害者(以女性為主)的臉孔,製造不雅影片,散播謀利,使受害人承受莫大的心理壓力。

Deepfake欺凌|美國比華利山中學生用AI偽造同學裸照 5涉案學生全退學處分

破解Deepfake有法

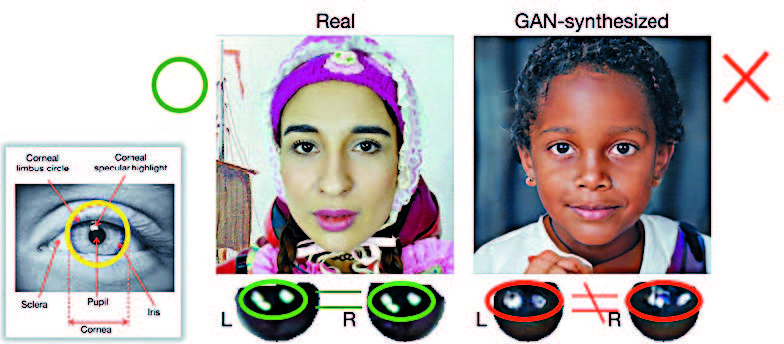

1. 雙目有神 偵測角膜反光度

Deepfake 犯罪活動日益猖獗,促使各地政府和專家不得不嚴肅對待,紛紛創製出不 同的識別技術,偵破肉眼真假難分的換臉影片。其中,美國紐約一所大學(University at Buffalo)的科學家利用眼球反光度,識別照片中的人到底是真人,還是Deepfake合成的假臉。

原來,人類雙眼角膜有鏡面般的表面,當我們看着一件物品,兩眼反射的光綫幾近相同。相反,Deepfake 合成的人臉,兩眼角膜的反光度通常不會一致,呈現不同形狀和角度的反射。專家藉此研發出一種分辨率達九成的演算法,有效分辨出真假照片。不過,道高一尺,魔高一丈,項目負責人表示,生成假照片的人可以後期調整眼睛的反光度,避過這套系統的偵測。

2. 臉有顏色 新法偵破假影片

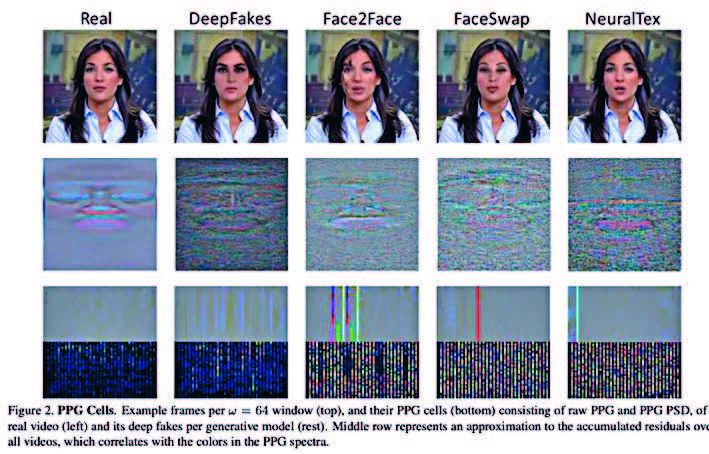

2022年六月,美國的電機電子工程師學會(IEEE)網站刊出一篇論文,專家研發出一套以血氧儀為基礎的演算法。人臉血管密布,雖然肉眼難以察覺到臉部血液流動的變 化,但以儀器量度,便能發現人類皮膚上區域性顏色變化,這套技術名為「光體積變化描記圖法」(Photoplethysmography,PPG),並早已應用於一些穿戴式智能產品,如 Apple Watch。專家指出,真實影片中的人臉會呈現一種符合規律的顏色變化,而合成的影片則呈現出一堆不穩定的 PPG 信號,在這套技術下無所遁形。

Deepfake 的正面應用

雖然 Deepfake 經常被濫用於犯罪用途,但技術本身無善惡之分,端看使用者的選擇而得出不同的結果。

- 無人駕駛:上文提到的 GAN 常應用於開發無人駕駛車輛,開發人員藉 GAN 生成大量虛構場景,模仿一些現實中難以大量取得的路況數據,如雪地等極端天氣,完善無人車上的人工智能,在突發情況下有更理想的應對方案。

- 電影製作:愈來愈多電影公司在影片中運用 Deepfake 技術,例如迪士尼研究室就與蘇黎世聯邦理工學院合作,以 Deepfake 為基礎,研發高解像度的換臉技術,使人物的五官和光綫更逼真和自然。有電影人表示,新技術可以使年老,甚至已逝的明星,以最佳面貌「出演」,滿足影迷的心願。

由此可見,科技的好與壞,很大程度上取決於使用者的目的,隨着新技術的普及和進步,學者開始擔心人類是否具備足夠的道德和智慧去運用這些力量,因而提出「科技倫理」專門討論如何應用科技的問題。

補充資料

科技倫理

美國哈佛大學開設一門名為「Embedded EthiCS」的課程,處理人類社會如何看待科技進步帶來的倫理問題,常見的議題例如修改人類基因、製造複製人、保障大數據下的私隱權 等。

而 Deepfake 的發展同樣帶來科技倫理的問題,因為其高度仿真的成品,使網絡出現大量真假難分的影片,加上大部分可靠的辨偽技術都掌握在專家手上,大眾難以辨別真相。令人擔憂這將會演變成一種新常態,即傳釋可靠資訊的權利被個別單位牢牢控制,而大眾將失去監督作用,最終大多數人成為少數人能夠輕易愚弄的對象。不過,這些大膽推測會否成真,就留待各位同學仔細思考。

答案:第四張是真實人臉

文:盧家彥 圖:星島圖片庫、網上圖片

相關文章:STEAM|眼見未為真!拆解Deepfake|星島教室

最新回應